Deepfakes Gelişirken Ülkeler Cevap Vermekte Zorlanıyor

Toplumların dijital sahtekarlıklarını oluşturmak için yüzleri, seslerini ve diğer özelliklerini değiştirmelerine izin veren yazılım olan Deepfake teknolojisi, son yıllarda 100.000’den fazla ülkedeki dijital olarak “soymak” için bir kripto para birimi dolandırıcılığı yapan Elon Musk’ın sentetik bir ikamesini yapmak için kullanmak. Telegram ve telefonda konuşmaların sesini taklit ederek verilerinden milyonlarca dolar çalmak.

Dünyanın çoğu yerinde yönetimler bu konuda fazla bir şey yükü. Yazılım yapılandırma ve erişilebilir hale gelse bile, kullanıcı ayarları için çok az yasa mevcuttur.

Çin istisna olmayı umuyor. Bu ay, ülke, manipüle edilmiş materyallerin öznenin izin sınıflarını ve dijital imzalar veya filigranlar taşımasını ve deepfake hizmet sunucularının “söylentileri çürütmek” için yolların sunmasını gereklilikleri kapsayan kuralları kabul etti.

Ancak Çin, derin sahtekarlıkları yönetmeye yönelik diğerlerini götürme aynı engellemeyle karşı karşıya: Teknolojinin en kötü suiistimalcileri, yakalanması en zor olanlar, anonim olarak çalışıyorlar, hızla adapte oluyorlar ve sentetik yaratımlarını sınırsız çevrimiçi platformlar aracılığıyla paylaşıyorlar. Çin’in mezrası, çok az ülke kurallarını benimsemesinin bir başka yöneticiyi de vurguladığı: Pek çok kişi, yöneticilik kurallarını ifade kısıtlaması barındırmak için kullanmaktan endişeleniyor.

Ancak teknoloji uzmanları, Pekin’in sadece talimatlarını yerine getirmek için diğer hükümetlerin derin sahte teknolojiye güç veren makine bilgisayarlarını ve yapay zeka ile nasıl başa çıktıklarını etkileyeceğini söyledi. Alanında sınırlı emsal ile, dünyanın dört bir yanındaki kanun koyucular taklit etmek veya reddetmek için test vakaları arıyorlar.

Pittsburgh Üniversitesi’nde İşbirliğine Dayalı Yapay Zeka Sorumluluğu Laboratuvarı’nı yürüten doktora sonrası araştırmacı Ravit Dotan, “Yapay zeka sahnesi küresel siyaset için ilginç bir yer, çünkü ülkelerin gidişatı kimin belirleyeceği konusunda rekabet ediyor” dedi. “Yasaların büyümeleri, ancak henüz ne gerçekleşemeyecekleri, bu nedenle çok fazla öngörülemezlik var.”

Deepfake’ler birçok olasılığa büyük umut vaat ediyor. Geçen yıl, Hollanda polisi, 13 yaşındaki cinayet hikayesinin dijital bir avatarını sürdürme ve günümüzde ailesinden ve arkadaşlarından oluşan bir grup arasında çekilmiş görüntülerini yayınlayarak 2003’teki soğuk bir davayı yeniden canlandırdı. Teknoloji aynı zamanda parodi ve hiciv için, sanal soyunma yoluyla kıyafet deneyen internette alışveriş yapanlar için, dinamik müze dioramaları için ve uluslararası film gösterimlerinde birden fazla dil çıkışı uman oyuncular için de kullanıldı. MIT Medya Laboratuvarı ve UNICEF’teki araştırmacılar, Kuzey Amerika ve Avrupa şehirlerinin görüntülerini Suriye savaşının neden olduğu savaş yarası manzaralarına dönüştürerek empatiyi denetlemek için benzer teknikler kullandılar.

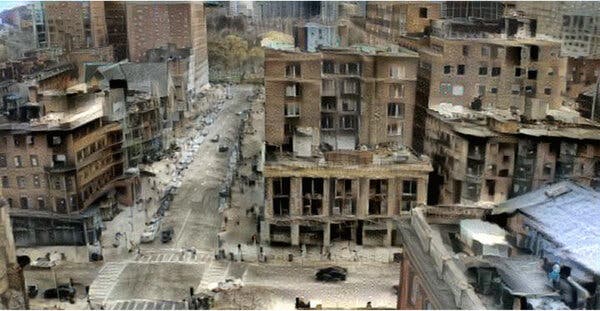

MIT Media Lab’deki araştırmacılar, bir yapay zeka sistemi Halep’in görüntüleriyle eğitti ve ondan benzer yıkımdan sonra diğer şehirlerin nasıl görüneceğini göstermesini istedi. Boston sahnesini bu derin sahtekarlığa dönüştürdü. Kredi… Pınar Yanardağ/MIT Media Lab

Ancak zorlu uygulamalar da çoktur. Meşru uzmanlar, deepfake’lerin güvenlik videolarına, vücut kameralarına ve diğer tanıklara olan güveni aşmak için kullanılabileceğinden endişe ediyor. (2019’da İngiltere’deki bir çocuk velayeti davasında üzerinde oynanmış bir kayıt, ebeveynin avukatına göre bir ebeveynin şiddetli tehditler savurduğunu gösteriyordu.) Dijital sahtecilikler, polis memurlarının itibarını sarsabilir veya onlara karşı teşvik edebilir ya da onları çılgınalamacalara gönderebilir. İç Güvenlik Bakanlığı ayrıca siber zorbalık, şantaj, stok yönetimiu ve siyasi istikrarsızlık gibi riskleri de barındırıyor.

Bazı uzmanlar, internet içeriğinin yüzde 90 kadarının birkaç yıl içinde sentetik olarak üretilebileceğini tahmin ediyor.

Yanlış Bilgilerin ve Yanlışların Yayılması

- Yeni Nesil İçin Dersler: Finlandiya’da, propagandayı öğretmenin yeni konuşmaları söyleniyor. İşte diğer okul başarılarından öğrenebilecekleri.

- Kovid Mitleri : Uzmanlar, koronavirüsle ilgili yanlış bilgileri görmen – özellikle Gab gibi aşırı sağcı platformlarda – muhtemelen pandeminin kalıcı bir görüşünü gördüklerini söylüyor. Ve kolay çözümler yok.

- Bir “Yetenek Savaşı”:Yanlış bilgileri muhtemelen yüksek bir sorumluluk olarak gören birçok şirket, bunları kontrol altında tutabilecek uzmanlığa sahip eski Twitter çalışanlarını işe almaya çalışıyor.

- Yeni Bir Yanlış Bilgi Merkezi mi?:Yanıltıcı açıklamalar, sahte haberler ve politikacıların derin sahte yorumları TikTok’ta gerçeği çarpıtmaya başlıyor.

Deepfake’lerin artan hacmi, “vatandaşların artık ortak bir gerçekliğe sahip olmadığı veya hangi bilgiye dayanabileceği konusunda güvenilir olduğu konusunda toplumsal bir kafa karışıklığı yaratabileceği” bir duruma yol açabilir; Avrupa emniyet teşkilatı Europol geçen yıl bir raporda, bazen ‘bilgi kıyameti’ veya ‘gerçeklik ilgisizliği’ olarak geçici bir durum” diye yazmıştı.

İngiliz yetkilileri geçen yıl, “kadınları neredeyse açığa çıkan soyan” ve 2021’in ilk sekizinde 38 milyon kez ziyaret edilen bir web sitesi gibi tehditlere karşı görevli bulundu. Ancak orada ve Avrupa Birliği’nde, teknolojiye korkuluklar koyma önerileri henüz gelmedi. kanun haline

Amerika Birleşik Devletleri’nde derin sahte maden araştırmak için federal bir görev gücü oluşturma noktasında durdu. New York Demokrat Temsilcisi Yvette D. Clarke, 2019’da ve yine 2021’de bir yasa tasarısı önerdi – Sömürüyü Hesap Verebilirlik Yasasına Tabi Tutarak Her Kişiyi Sahte Görünüşlerden Koruma – henüz oylamaya gelmedi. Bu yıl tasarıyı yeniden sunmayı planladığını söyledi.

Bayan Clarke, derin sahtelerin filigran veya koruyucu etiketler taşımasını gerektirecek olan yapısının “koruyucu bir önlem” olduğunu söyledi. Buna karşılık, yeni Çin’i “daha çok bir kontrol organları” olarak tanımladı.

“Sofistike sivil toplumların çoğu bunun nasıl silah haline getirilebileceğin ve yıkıcı gücünün farkındalığı” dedi ve ABD’nin başka bir öncüyü takip etmek yerine kendi standartlarını belirleme konusunda daha cesur olması gerektiğini de sözlerine ekledi.

Bayan Clarke, “Çinlilerin teknoloji alanında yemek yemeğimizi yemesini hiç istemiyoruz” dedi. “Teknoloji endüstrisi ve bu bulut gölgelerini korumaları Gözetmenlerimiz için temel oluşturabilmek istiyoruz.”

Ancak silahlı güçler, sektör hala derin sahtekarlıklarını tespit edemediğini ve kötü niyetli kullanımlarını yönlendirmek için mücadele ettiğini söyledi. California’daki bir avukat, 2021’de bir hukuk dergisinde, bazı derin sahte kuralların “neredeyse aşılmaz bir fizibilite sorunu” olduğu ve (geçerleri anonim) tacizciler verileri kolayca gizleyebildiği için “işlevsel olarak uygulanamaz” olduğunu yazdı.

Amerika Birleşik Devletleri’nde var olan kurallar büyük ölçüde siyasi veya pornografik derin sahtekarlıkları hedefliyor. Silikon Vadisi’nin bazı kısımlarını temsil eden ve bu tür hükümlerin sponsoru olan California Eyalet Meclisi’nde bir Demokrat olan Marc Berman, yasalarını davalar veya para cezaları yoluyla yürütmeye yönelik herhangi bir çabadan haber olmadığını söyledi. Ancak, bir deepfaking toplantıları, yasalarından birini uyarak, 2020 seçimlerinden önce Başkan Donald J. Trump’ı taklit etme sonucunu ortadan kaldırdığını söyledi.

New York da dahil olmak üzere yalnızca birkaç eyalet derin sahte pornografiyi kısıtlıyor. 2019’da yeniden hamilelik için yarışırken, Houston belediye başkanı, bir aday arkadaşından gelen kritik bir açıklamasının, bazı yanıltıcı siyasi derin sahtekarlıkları yasaklayan bir Teksas’ı yaşadığını çiğnediğini söyledi.

Bay Berman, “Değerin yarısı, daha fazla insanın sosyal medya platformlarında görülmeleri hakkında biraz daha şüpheci olmasına neden oluyor ve insanların her şeyi kullandıkları gibi görmeye teşvik ediyor” dedi.

Ancak teknoloji uzmanları, kanun yapıcılar ve kurbanlar daha güçlü koruma talep etseler de ihtiyatlı olmaya da teşvik ediyorlar. Deepfake kanunlarının hem aşırı kapsamı hem de dişsiz olma riskini taşıdığını söylediler. Politika veya kültür üzerine geçerli yorumlar olarak tasarlanmış deepfake’lere etiketler veya sorumluluk reddi beyanlarını zorlamak da içerikten daha az güvenilir müşterilere neden olabilir, diye eklerler.

Electronic Frontier Foundation gibi dijital hak grupları, yasa koyucuları derin sahte polisliği teknoloji işletmeye bırakmaya veya dolandırıcılık, telif hakkı yönetimi, müstehcenlik ve iftira gibi ortamları ele alan mevcut bir yasal çerçeveyi kullanmaya zorluyor.

Sivil özgürlükler avukatı David Greene, “Bu, yaşamında neredeyse her zaman zararlı olmayan, insanlar meşru, üretken konuşmadan soğutan malzemeleri yakalayacak olan hükümet müdahalesinden, zararlara karşı en iyi çözümdür” dedi. Elektronik Sınır Vakfı.

Birkaç ay önce Google, yapay zeka sistemlerini derin sahtekarlıklar oluşturmak üzere eğitmek için insanların bir veri analiz aracı olan Colaboratory platformunu kullanmayı yasaklamaya başladı. The Verge’e göre sonbaharda, bir görüntü oluşturma aracı olan Stable Diffusion’ın genel yapısı şirket, çıplak ve pornografik içerik oluşturma çalışan kullanıcıları kapsayan bir güncelleme başlattı. Meta, TikTok, YouTube ve Reddit, yanıltıcı olması amaçlı derin sahteleri yasaklar.

Toplu konutlar veya yasaklar, sürekli olarak uyumu sağlamak ve geliştirmek üzere kullanmak üzere bir tesisatı kontrol altına almakta zorlanabilir. Geçen yıl, RAND Corporation’dan araştırmacılar, 3.000’den fazla deneğe bir dizi video gösterilerinde ve kullandıklarında manipüle edilmiş olanlardan (iklim aktivisti Greta Thunberg’in bir deepfake’i gibi) belirlemelerini istediklerinde, deepfake’leri tanımlamanın ne kadar zor olabileceğini gösterdiler. iklim değişikliğinin gitmeyi reddetmek).

Grup, zamanın üçte birinden fazla yanıldı. Carnegie Mellon Üniversitesi’nde makine makinelerini okuyan birkaç normal öğrenciden oluşan bir alt küme bile, ortalama yüzde 20’sinden fazlasında yanıldı.

Microsoft ve Adobe gibi kısıtlamalardan gelen mülkler artık medyanın sınırlarını denetlemeye ve yapay içeriği işaretleyen tutarsızlıklarını bilmek için moderasyona kadar eğitmeye çalışıyor. Ancak kusurları düzeltmenin, filigranları ortadan kaldırmanın ve silme için meta verileri değiştirmenin yeni parçaları keşfeden deepfake yaratıcılarını geride bırakmak için sürekli bir mücadele içindeler.

RAND’da bir fizik bilimcisi olan Jared Mondschein, “Deepfake yaratıcıları ve deepfake dedektörleri arasında teknolojik bir silahlanma yarışı var” dedi. “Deepfake’leri daha iyi tespit edilen şirketler arasında başlayana kadar, herhangi bir mevzuatın diş sahibi olması gerçekten zor olacak.”